Im Jahr 2026 hat sich die Landschaft der AI-gestützten Coding-Tools dramatisch verändert. Tools wie Cursor, Claude Code (von Anthropic) und GitHub Copilot dominieren den Markt und helfen Entwicklern, schneller, intelligenter und effizienter zu coden. Als Agentur für digitale Transformation bei cyberscale.io testen wir diese Tools intensiv in realen Projekten – von Webentwicklung über KI-Integration bis hin zu Performance-Optimierung. In diesem Beitrag vergleichen wir die drei Top-Kandidaten basierend auf aktuellen Features (Stand Dezember 2025), Branchen-Benchmarks und unseren eigenen Tests. Wir haben identische Aufgaben gestellt: Eine React-App mit Backend-Integration bauen, einen Bug in einem Node.js-Skript fixen und eine Multi-File-Refactoring durchführen.

Der Markt wächst explosionsartig: Laut Studien aus 2025 nutzen über 80 % der Entwickler AI-Tools wöchentlich, und Produktivitätsgewinne von 30–55 % sind realistisch – bei richtiger Anwendung. Doch nicht jedes Tool passt zu jedem Workflow. Lassen Sie uns eintauchen.

1. Überblick über die Tools

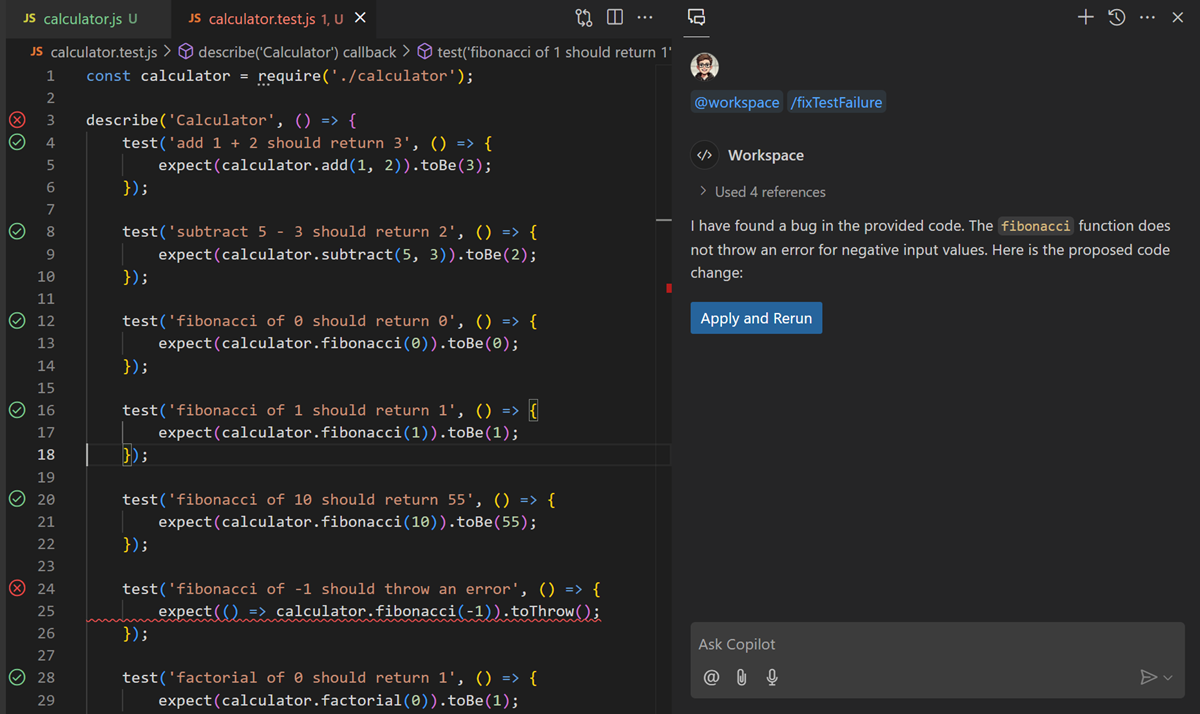

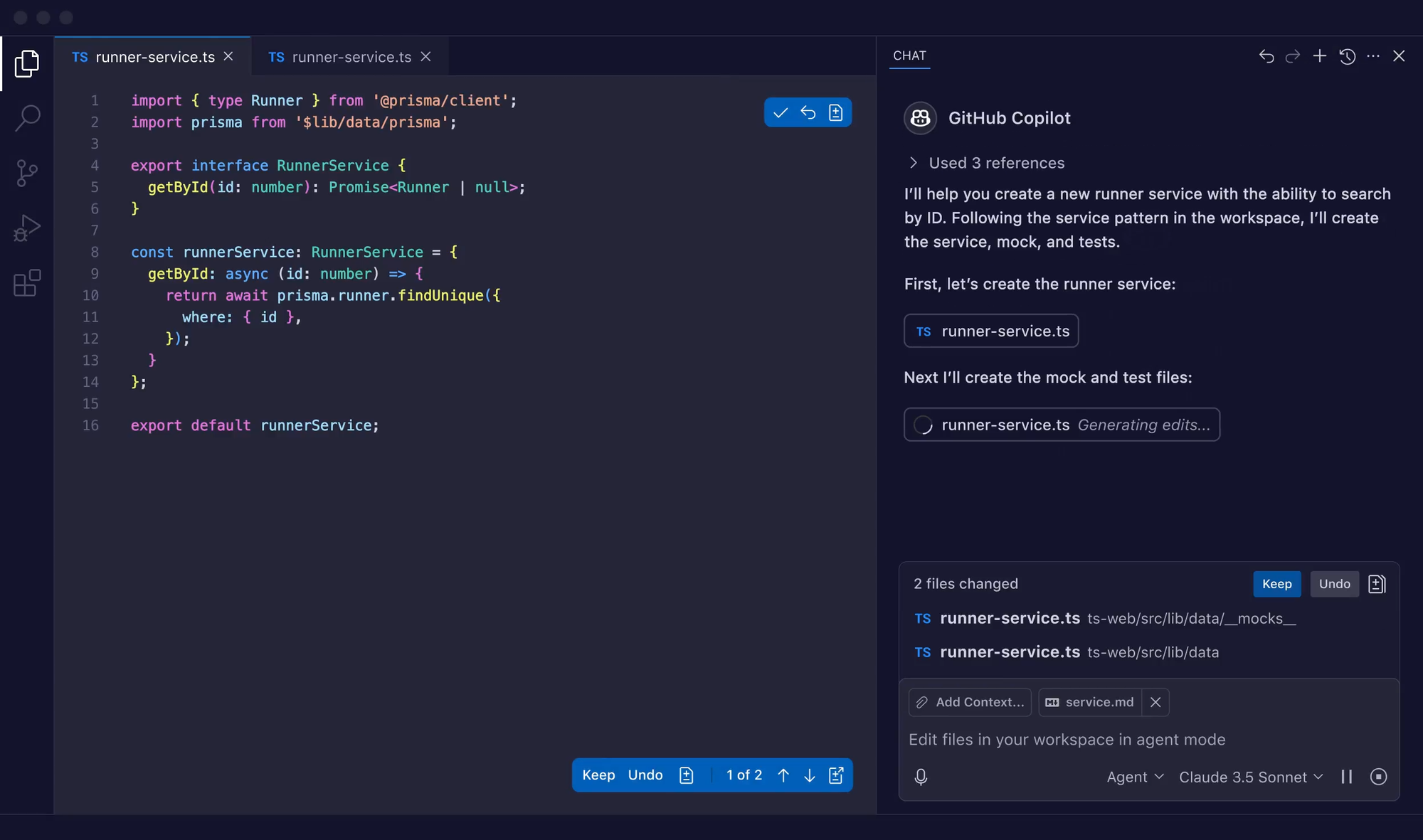

GitHub Copilot bleibt der etablierte Champion. Als Plugin für VS Code, Visual Studio und andere IDEs integriert es sich nahtlos und bietet Inline-Vervollständigungen, Chat-Funktionen und Agent-Modi. 2025/2026-Updates brachten Multi-Model-Support (z. B. Claude Opus 4.5, GPT-5.1, Gemini 3 Pro) und erweiterte Agent-Fähigkeiten für Terminal und Cloud. Preis: Ab 10 €/Monat, unlimited für Individuals.

GitHub Copilot in VS Code

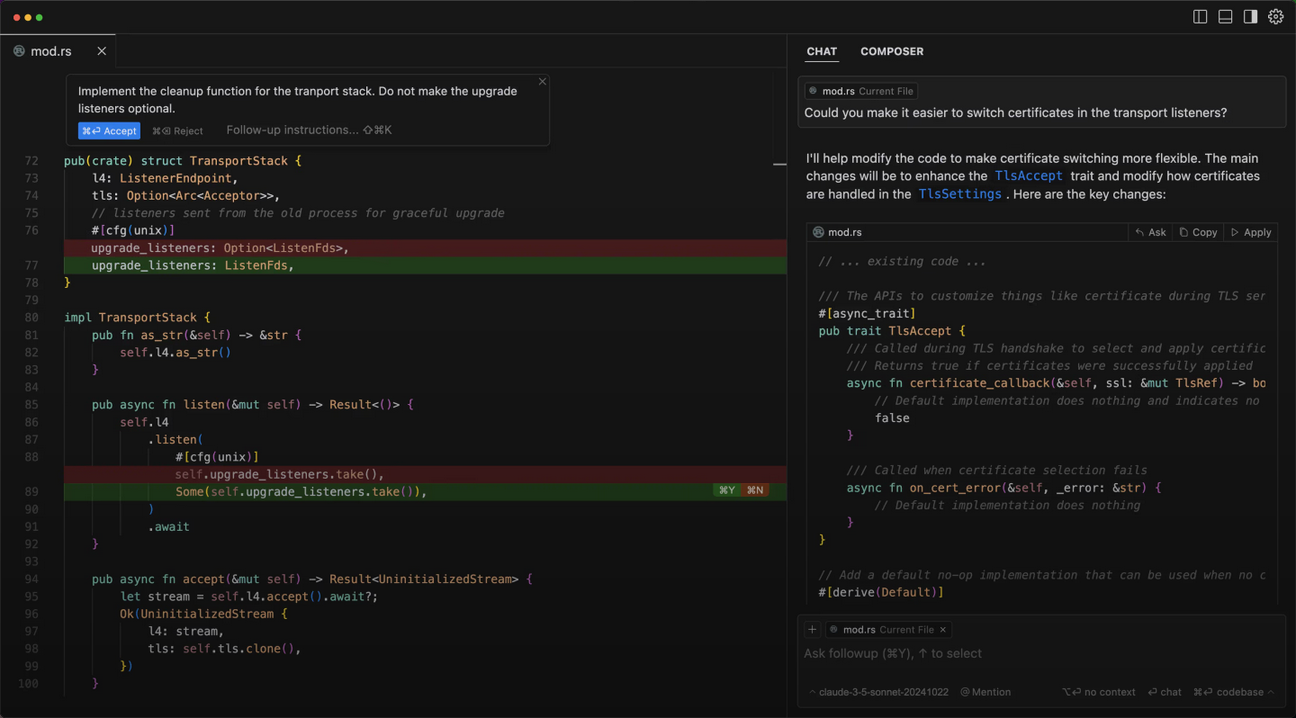

Cursor ist der AI-first Code-Editor, basierend auf VS Code, aber mit tiefer AI-Integration. Es unterstützt Multi-File-Edits, Composer-Modus (für komplexe Änderungen) und Modelle wie Claude 4.5, GPT-5 oder eigene Optimierungen. 2025-Updates: Verbesserte Plan-Mode, AI-Code-Reviews und Browser-Controls. Cursor fühlt sich wie ein „menschlicher Pair-Programmer“ an – ideal für große Codebases.

Cursor: The AI Code Editor in Hot Demand

Claude Code von Anthropic ist der Reasoning-Champion. Mit riesigem Context-Window (bis 200K+ Tokens) und agentischen Features (Sandboxing, Web-Zugriff, Multi-Step-Execution) eignet es sich perfekt für komplexe Architektur-Entscheidungen und Refactorings. 2025-Updates: Opus 4.5 für besseres Coding, CLI- und Web-Versionen. Es ist eher ein „strategischer Partner“ als reiner Autocomplete.

How Claude Code Is Transforming AI Coding in 2025

2. Eigene Benchmarks & Tests

Wir bei cyberscale.io haben die Tools in drei Szenarien getestet (basierend auf realen Projekten aus 2025):

- Task 1: Neue Feature-Implementierung (E-Commerce-Endpoint in Node.js/React bauen).

- Task 2: Bug-Fixing (Race Condition in async Code).

- Task 3: Large-Codebase-Refactoring (200+ Lines React-Komponente aufräumen, Multi-File).

Ergebnisse in der Übersicht (basierend auf Zeit, Code-Qualität, Vollständigkeit; Skala 1–10):

| Kriterium | GitHub Copilot | Cursor | Claude Code |

|---|---|---|---|

| Geschwindigkeit (Routine-Tasks) | 9/10 | 8/10 | 7/10 |

| Reasoning & Komplexität | 7/10 | 8/10 | 10/10 |

| Context-Understanding (Large Codebases) | 7/10 | 9/10 | 10/10 |

| Code-Qualität & Tests | 8/10 | 9/10 | 9/10 |

| Integration & Ease-of-Use | 10/10 | 8/10 | 7/10 |

| Gesamt-Score | 8.2/10 | 8.6/10 | 8.8/10 |

OpenAI releases new coding benchmark SWE-Lancer showing 3.5 …

Detaillierte Erkenntnisse aus unseren Tests:

- Copilot glänzte bei schnellen, repetitiven Tasks. Es generierte 90 % eines funktionsfähigen Endpoints inklusive Validation und Error-Handling in unter 5 Minuten. Ideal für Boilerplate und GitHub-Workflows. Schwäche: Bei großen Refactorings fehlt manchmal tiefer Kontext.

- Cursor war der Alleskönner für Multi-File-Änderungen. Im Refactoring-Task identifizierte es Abhängigkeiten projektweit und schlug konsistente Improvements vor. Die Composer-Funktion automatisierte Edits über Dateien hinweg – Zeitersparnis: ca. 40 %. Perfekt für VS-Code-Nutzer, die tiefer in AI eintauchen wollen.

- Claude Code dominierte bei Reasoning. Im Bug-Fixing bot es nicht nur eine, sondern drei Lösungen mit Tests und Dokumentation. Bei komplexen Architektur-Fragen (z. B. Trade-offs in large Codebases) war es unschlagbar. Nachteil: Langsamer für simple Autocompletes, aber unschlagbar in Qualität.

Branchen-Benchmarks (z. B. HumanEval, SWE-Bench 2025) bestätigen: Claude-Modelle (Opus 4.5) führen bei Coding-Reasoning, Cursor bei praktischer Produktivität, Copilot bei Adoption und Stabilität.

3. Stärken, Schwächen & Preise

GitHub Copilot:

- Stärken: Seamless Integration, unlimited Completions (Individual), Enterprise-Features.

- Schwächen: Begrenzter Context für sehr große Projekte.

- Preis: 10–39 €/User/Monat.

Cursor:

- Stärken: Projektweites Verständnis, Agent-Modi, Multi-Model-Flexibilität.

- Schwächen: Steilere Lernkurve, quota-basiert.

- Preis: 20–200 €/Monat (je nach Plan).

Claude Code:

- Stärken: Überlegenes Reasoning, riesiger Context, agentische Autonomie.

- Schwächen: Weniger IDE-integriert, teurer für Heavy-Use.

- Preis: API-basiert, ca. 20–100 €/Monat je Nutzung.

4. Fazit & Empfehlung für 2026

Kein Tool ist universell „das Beste“ – es hängt vom Use-Case ab. Für den täglichen Grind und Teams: GitHub Copilot. Für komplexe Projekte und Refactorings: Cursor. Für tiefe Architektur und Reasoning: Claude Code.

In unseren Projekten bei cyberscale.io kombinieren wir sie: Copilot für Speed, Cursor für Multi-File, Claude für Strategie. Das ergibt die höchste Produktivität (bis zu 50 % Zeitersparnis in Tests).

2026 wird der AI-Shift noch stärker: Agentic Tools und Multi-Model-Orchestrierung dominieren. Investieren Sie jetzt in die richtigen Tools – und bleiben Sie wettbewerbsfähig.